卒業研究ではKosmos-2という既存のマルチモーダルモデル(MLLM)を使用してChain of thoughtと物体領域によるマルチモーダルモデルによる説明性の実現を目指しました。

マルチモーダルモデルを含むAIモデルにはなぜそのような出力をしたのかわからないブラックボックス性の問題があります。しかし、最近自然言語処理分野でLLMに質問を入力した際、出力となる解答に加え解答に対する根拠となる思考過程を出力��するChain of Thought(思考連鎖、CoT)という研究が登場しました。またCoTがモデルの出力に対する説明になることに着目し、CoTをマルチモーダルモデルに適用したという研究も登場しました。私はこの先行研究を発展させ着目し物体領域を扱えるマルチモーダルモデルでの説明性の実現を卒業研究で目指しました。

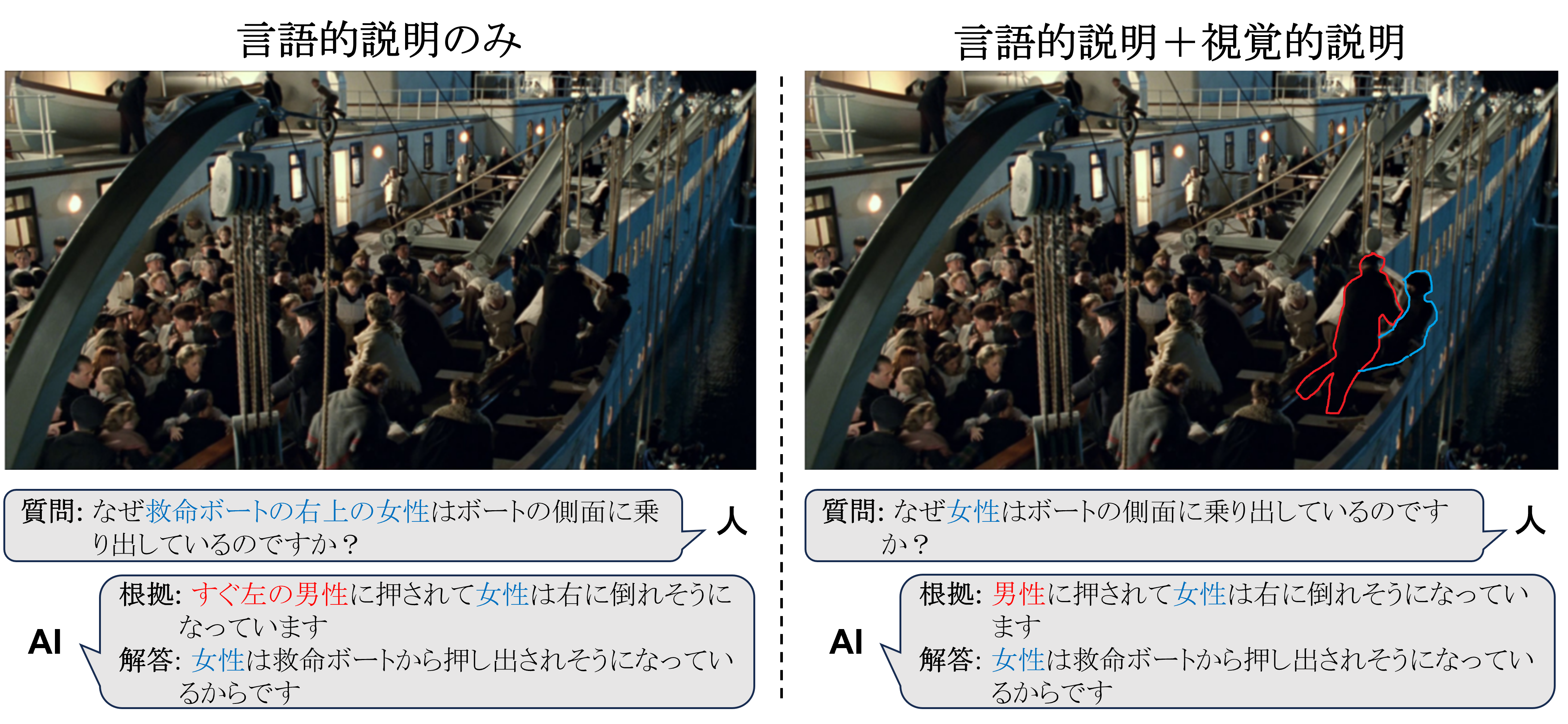

具体的には質問に対してテキストによる言語的説明だけでなく、物体領域による視覚的説明の両方を行えるモデルを構築しました。例えば下記の画像の左のようにAIモデルが画像に関する質問に答える際、言葉だけではどの人物を指しているかわかりません。 しかし、右のようにテキストに対応した領域をモデルが出力することで容易に人物を認識できるようになります。